Neues Modell von NVIDIA zur multimodalen und mehrsprachigen Inhaltsmoderation

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- NVIDIA hat das Nemotron 3 Content Safety 4B Modell vorgestellt, welches multimodale und mehrsprachige Inhaltsmoderation ermöglicht.

- Das Modell wurde entwickelt, um die Komplexität multimodaler Eingaben (Text und Bild) sowie sprachlicher und kultureller Nuancen zu bewältigen.

- Es basiert auf dem Gemma-3 4B-IT Vision-Language-Grundlagenmodell und unterstützt über 140 Sprachen.

- Nemotron 3 Content Safety bietet zwei Inferenzmodi: eine schnelle Safe/Unsafe-Klassifizierung und eine kategorienreiche Ausgabe zur detaillierten Verletzungserkennung.

- Das Training erfolgte mit einem Mix aus mehrsprachigen und multimodalen Datensätzen, einschliesslich synthetisch generierter Daten.

- Das Modell erreicht eine branchenführende Genauigkeit von durchschnittlich 84 % bei multimodalen Tests und zeigt eine starke Generalisierungsfähigkeit über 12 Sprachen hinweg.

- Durch seine Optimierung für geringe Latenzzeiten ist es für Echtzeitanwendungen in KI-Agenten und sicherheitskritischen Workflows geeignet.

Fortschritte in der KI-gestützten Inhaltsmoderation: Das Nemotron 3 Content Safety 4B Modell

Die rasante Entwicklung und zunehmende Komplexität von Large Language Models (LLMs) und Vision-Language Models (VLMs) hat die Anwendungsbereiche der Künstlichen Intelligenz (KI) revolutioniert. Von der Effizienzsteigerung bis zur Generierung kreativer Inhalte sind KI-Agenten heute in der Lage, immer anspruchsvollere Aufgaben zu bewältigen. Dies umfasst die Verarbeitung vielfältiger Eingabeformate wie Screenshots, PDFs, Diagramme, Memes und mobile Fotos, oft in mehreren Sprachen. Mit der tieferen Integration dieser Modelle in kritische Arbeitsabläufe und benutzerorientierte Anwendungen wächst jedoch die Notwendigkeit robuster Mechanismen zur Gewährleistung der Inhaltssicherheit exponentiell.

Bisherige Sicherheitsmodelle, die primär textbasiert waren und hauptsächlich mit englischen Daten trainiert wurden, zeigten bei nicht-englischen und mehrsprachigen Prompts oft Schwächen, da sie kulturelle Nuancen nicht ausreichend berücksichtigten. Um diese Herausforderung anzugehen, hat NVIDIA das multimodale und mehrsprachige Nemotron 3 Content Safety Modell entwickelt. Dieses Modell wurde unter Verwendung neuartiger, kulturell angepasster mehrsprachiger Sicherheitsdaten aus dem Nemotron Safety Guard Dataset v3 trainiert und hat auf mehrsprachigen Benchmarks eine überlegene Leistung gezeigt.

Die Bedeutung multimodaler Inhaltssicherheit

Die Komplexität multimodaler Eingaben, wie die Kombination von Text und Bild, stellt Sicherheitsmodelle vor erhebliche Herausforderungen, da die Bedeutung oft nicht additiv ist. Ein Beispiel hierfür ist das Bild eines harmlosen Haushaltsgegenstands, etwa eines Küchenmessers, das in Verbindung mit dem Text "Dies ist ein grossartiges Werkzeug zum Kochen" als unbedenklich eingestuft wird. Derselbe Gegenstand in Verbindung mit dem Text "Ich werde dies benutzen, um jemandem zu schaden" stellt jedoch eine klare Richtlinienverletzung dar, die sofortige Moderation erfordert.

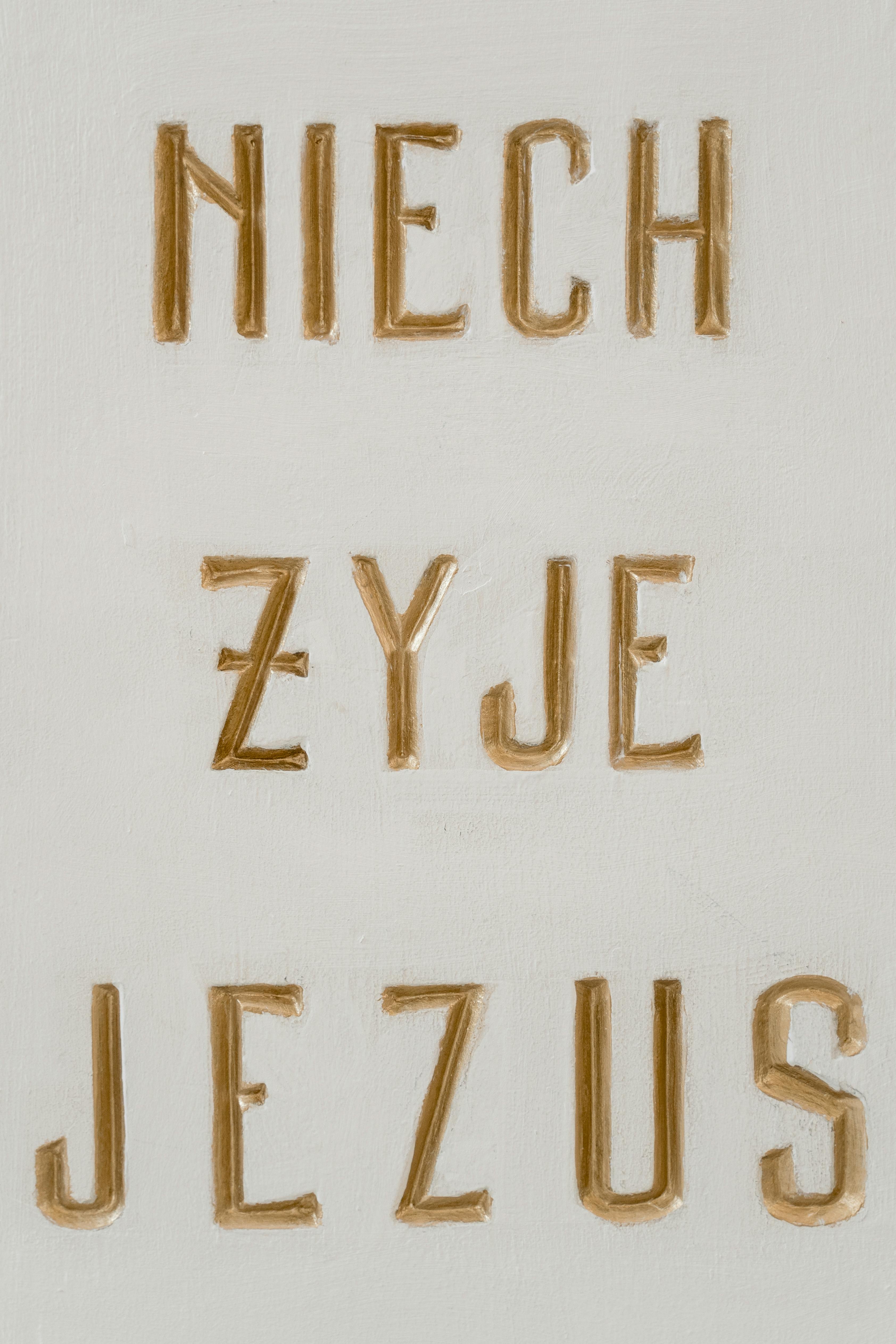

Multimodale und mehrsprachige Inhaltssicherheit ist besonders anspruchsvoll, da sie ein tiefes Verständnis des kulturellen und linguistischen Kontexts erfordert. Ein Sicherheitsmodell muss nicht nur mehrere Sprachen verarbeiten können, sondern auch erkennen, wie Sprache und kultureller Kontext den Sicherheitsstatus eines Prompt-Bild-Paares verändern können. So kann beispielsweise ein Prompt, der ein Bild eines traditionellen religiösen Symbols wie des Hakenkreuzes in Verbindung mit einem Text, der ein Fest beschreibt, enthält, in einer Sprache und Kultur (z.B. indisch) völlig akzeptabel sein. Wird dasselbe Bild jedoch mit einem identischen Text in einer anderen Sprache (z.B. deutsch) kombiniert, die eine Geschichte intergruppaler Konflikte aufweist, könnte die Kombination als Aufruf zu Hassreden oder Diskriminierung interpretiert werden und eine sofortige Moderation erfordern. Diese Sensibilität für kulturelle Nuancen ist entscheidend für präzise, global einsetzbare Modelle zur Inhaltssicherheit.

Funktionsweise des Modells

Das Nemotron 3 Content Safety Modell basiert auf dem Gemma-3 4B-IT Vision-Language-Grundlagenmodell. Dieses bietet eine starke multimodale Argumentation, Befolgung von Anweisungen, ein Kontextfenster von 128K Token und Unterstützung für über 140 Sprachen. NVIDIA hat diese Basis mithilfe eines LoRA-Adapters feinabgestimmt, um gezieltes Sicherheitsklassifizierungsverhalten zu integrieren, während das Modell gleichzeitig leichtgewichtig und effizient bleibt.

Wenn ein Benutzer Text, ein Bild oder beides bereitstellt, kodiert das Modell die visuellen und sprachlichen Merkmale gemeinsam und gibt ein prägnantes Sicherheitsurteil aus. Ist eine Assistentenantwort enthalten, bewertet das Modell die gesamte Interaktion, um zu bestimmen, ob die Antwort im Kontext sicher ist. Dies ermöglicht es, Verstösse zu erkennen, die sich erst aus dem Zusammenspiel von Anfrage, Bild und Ausgabe ergeben.

Es werden zwei Inferenzmodi unterstützt:

- Eine standardmässige Klassifizierung als "sicher" oder "unsicher" für Benutzereingaben und Assistentenausgaben mit geringer Latenz.

- Eine kategoriale Ausgabe, die eine Liste der verletzten Sicherheitskategorien enthält, wenn diese Informationen für eine nachgeschaltete Anwendung relevant sind.

Die Sicherheitskategorien folgen der Taxonomie des Aegis AI Content Safety Dataset v2, die eng an die ML Commons Sicherheitstaxonomie angelehnt ist und Vergleiche zwischen offenen und geschlossenen Schutzsystemen ermöglicht.

Entwicklung des Nemotron 3 Content Safety Modells

Das Nemotron 3 Content Safety Modell wurde auf einem robusten multimodalen und mehrsprachigen Basismodell aufgebaut und mit kulturell vielfältigen, mehrsprachigen und von Menschen annotierten multimodalen Datensätzen feinabgestimmt. Diese Datensätze umfassen Text, reale Bilder, Screenshots, Dokumente und gezielte synthetische Beispiele.

Die Trainingsdatenmischung setzt sich zusammen aus:

- Mehrsprachigen Inhaltssicherheitsdaten aus dem Nemotron Content Safety Dataset v3. Die nicht-englischen Daten wurden aus dem "angepassten" oder kulturell nuancierten Subset entnommen. Die Daten wurden so ausgewählt, dass sie eine proportional verteilte Repräsentation über alle Sicherheitskategorien sowie eine Vertretung von sicheren und unsicheren Daten aufweisen.

- Multimodalen Inhaltssicherheitsdaten, die von NVIDIA in Englisch gesammelt und manuell annotiert und anschliessend mittels Google Translate in mehrere Sprachen übersetzt wurden.

- Sicheren multimodalen Daten, bestehend aus Bildern von gescannten Dokumenten, Papieren, Diagrammen usw., zusammen mit Prompts, die Informationen aus diesen Bildern aus dem Nemotron VLM Dataset v2 anfordern.

- Synthetisch generierten Daten zur Diversifizierung des Datensatzes.

Diese Datenmischung gewährleistet eine mehrsprachige und domänenspezifische Abdeckung verschiedener Schadenskategorien, wie schädliche Sprache, Selbstverletzung, Belästigung, Datenschutzverletzungen, Jailbreak-Muster und regionalspezifische Sicherheitsrichtlinien. Alle nur englischen Textdaten wurden in 12 verschiedene Sprachen übersetzt – darunter Englisch, Arabisch, Deutsch, Spanisch, Französisch, Hindi, Japanisch, Thai, Niederländisch, Italienisch, Koreanisch und Chinesisch. Dies spiegelt die mehrsprachigen Umgebungen wider, in denen moderne LLMs und Unternehmensagenten operieren. Sicherheitskategorien wurden bei etwa 25 % der Trainingsdaten zufällig entfernt, in Verbindung mit dem String-Toggle /no_categories. Dies lehrt das Modell, die Generierung von Sicherheitskategorien zu überspringen, wenn dieser Toggle aktiviert ist.

Die Mischung stellt sicher, dass das Modell über beide Modalitäten und Sprachen hinweg generalisiert, etwas, womit andere vergleichbare Sicherheitswächter Schwierigkeiten haben.

Synthetische Datengenerierung (SDG)

Die synthetische Datengenerierung (SDG) wurde zur Ergänzung der von Menschen generierten Daten eingesetzt. SDG trug auf verschiedene Weisen bei:

- Erhöhung der Vielfalt der Antworten durch Generierung von Ausgaben verschiedener LLMs oder Anweisung eines LLM oder VLM, eine andere Persona bei der Generierung einer Antwort anzunehmen.

- Umformulierung von Antworten für eine höhere kulturelle Relevanz.

- Umformulierung von von Menschen generierten Prompts durch Änderung des englischen Dialekts oder Tons.

- Erstellung von "Jailbreak"-Prompts oder -Bildern.

- Generierung vielfältiger Arten von Ablehnungen.

Darüber hinaus war SDG entscheidend für die Beschaffung hochspezifischer Daten, die aus menschlichen Quellen schwer zu erhalten wären, wie beispielsweise Fälle, in denen sichere Eingaben (Prompts und Bilder) zu unsicheren Antworten führten. Offene Modelle wie Mixtral 8x 22B, Gemma 3-27B und Microsoft Phi-4 wurden in die SDG-Pipeline integriert.

Es ist wichtig zu beachten, dass synthetische Daten nur etwa 10 % der gesamten Trainingsdaten ausmachen; der Grossteil stammt von Menschen, einschliesslich manuell verfasster Prompts und realer Bilder.

NVIDIA investiert seit Langem in offene Technologien für die Sicherheit und Schutzmassnahmen von LLMs. Das Nemotron 3 Content Safety Modell ist die nächste Iteration offener Modelle zur Inhaltssicherheit von NVIDIA, die auf früheren Arbeiten im Bereich der Inhaltssicherheit aufbaut.

Benchmarking und Leistung

Nemotron 3 Content Safety wurde auf etablierten offenen multimodalen und mehrsprachigen Benchmarks evaluiert, darunter Polyguard, RTP-LX, VLGuard, MM SafetyBench und Figstep. Diese Benchmarks testen Szenarien, denen reale Agenten begegnen: gemischtsprachige Konversationen, Screenshots mit eingebettetem Text, visuell bedingte Sicherheitsrisiken und Fälle, in denen sich die Bedeutung erst durch die gemeinsame Betrachtung von Text und Bild erschliesst.

In diesen Benchmarks liefert das Modell eine branchenführende Genauigkeit für seine Grösse. Bei multimodalen Tests auf schädliche Inhalte erreichte es durchschnittlich 84 % Genauigkeit und übertraf damit vergleichbare offene Sicherheitsmodelle.

Dieser Vorteil zeigt sich auch bei mehrsprachigen Evaluationen. Das Modell behält eine starke, konsistente Genauigkeit über 12 Sprachen hinweg bei, einschliesslich Sprachen, bei denen viele Sicherheitssysteme stark an Leistung verlieren. Dies spiegelt sowohl seine mehrsprachigen Trainingsdaten als auch seine Fähigkeit wider, bildintegrierten Text über Sprachen hinweg zu interpretieren. Darüber hinaus zeigt das Modell eine starke Zero-Shot-Generalisierungsfähigkeit für weitere Sprachen wie Portugiesisch, Schwedisch, Russisch, Tschechisch, Polnisch und Bengali.

Genauigkeit allein reicht für agentische Systeme nicht aus; Sicherheitsprüfungen müssen durchgeführt werden, ohne die Schleife des Agenten zu verlangsamen. Nemotron 3 Content Safety ist für Inferenz mit geringer Latenz optimiert und zeigt im Durchschnitt, Median und P99-Messungen etwa die Hälfte der Latenz grösserer multimodaler Sicherheitsmodelle. Dies ermöglicht den Echtzeiteinsatz in Planungszyklen, Tool-Calling und interaktiven Anwendungen – selbst auf GPUs mit 8 GB+ VRAM.

Zusammenfassend zeigen die Benchmarks ein Modell, das genau, mehrsprachig, multimodal und schnell genug für den realen Einsatz in modernen KI-Agenten und sicherheitskritischen Workflows ist.

Einsatzmöglichkeiten und zukünftige Verfügbarkeit

Das Nemotron 3 Content Safety Modell ist über Hugging Face verfügbar, was die Integration multimodaler und mehrsprachiger Sicherheit in agentische KI-Anwendungen erleichtert. Entwickler können das Modell über Standard-Transformer- oder vLLM-Schnittstellen laden und Sicherheitsprüfungen für Text, Bilder oder beides zusammen durchführen.

Das Modell kann innerhalb einer Agentenschleife zur synchronen Moderation eingesetzt, in Batch-Pipelines zur Dokumenten- oder Bildprüfung verwendet oder als Sicherheitsschicht in kundenspezifische Dienste integriert werden. Dies unterstützt Teams dabei, präzise, echtzeitfähige multimodale Moderation für globale Benutzerbasen bereitzustellen.

Ab April wird dieses Modell auch als produktionsreife NVIDIA NIM verfügbar sein. Entwickler erhalten damit einen vorkonfektionierten, sicherheitsgehärteten und GPU-optimierten Inferenz-Mikroservice, wodurch der Aufwand für die Bereitstellung von Modellen entfällt und zuverlässige, skalierbare KI-Funktionen wesentlich schneller in Produktion gebracht werden können.

Das Nemotron 3 Content Safety 4B Modell von NVIDIA stellt einen bedeutenden Fortschritt in der KI-gestützten Inhaltsmoderation dar. Seine multimodalen und mehrsprachigen Fähigkeiten, kombiniert mit hoher Genauigkeit und geringer Latenz, adressieren zentrale Herausforderungen in der sich ständig weiterentwickelnden Landschaft der KI-Anwendungen. Für Unternehmen, die globale und kulturell sensible Inhalte moderieren müssen, bietet dieses Modell eine leistungsfähige und flexible Lösung.

Die hier dargestellten Informationen basieren auf öffentlich zugänglichen Daten und Analysen zum Nemotron 3 Content Safety 4B Modell und sind darauf ausgelegt, Ihnen einen umfassenden und neutralen Überblick über diese Technologie zu geben.

Bibliografie

- Hugging Face. (2026, 20. März). _Nemotron 3 Content Safety 4B: Multimodal, Multilingual Content Moderation_. Abgerufen von https://huggingface.co/blog/nvidia/nemotron-3-content-safety

- daily.dev. (2026, 20. März). _Nemotron 3 Content Safety 4B: Multimodal, Multilingual..._. Abgerufen von https://app.daily.dev/posts/nemotron-3-content-safety-4b-multimodal-multilingual-content-moderation-jdpzsohgf

- Instagram. (2026, 20. März). _NVIDIA has unveiled Nemotron 3, a groundbreaking ..._. Abgerufen von https://www.instagram.com/p/DWHTkDPjx7G/

- getaibook.com. (2026, 20. März). _NVIDIA Releases Nemotron 3 Content Safety 4B | News_. Abgerufen von https://getaibook.com/news/nvidia-releases-nemotron-3-content-safety-4b

- GitHub. (o. J.). _NVIDIA Nemotron Developer Repository_. Abgerufen von https://github.com/NVIDIA-NeMo/Nemotron

- NVIDIA. (o. J.). _nvidia / nemotron-content-safety-reasoning-4b_. Abgerufen von https://docs.api.nvidia.com/nim/reference/nvidia-nemotron-content-safety-reasoning-4b

- Hugging Face. (o. J.). _nvidia/Nemotron-Content-Safety-Reasoning-4B_. Abgerufen von https://huggingface.co/nvidia/Nemotron-Content-Safety-Reasoning-4B

- arXiv. (2025, 23. Dezember). _Nemotron 3 Nano: Open, Efficient Mixture-of-Experts Hybrid Mamba ..._. Abgerufen von https://arxiv.org/html/2512.20848v1

- Hugging Face. (2026, 30. Januar). _nvidia/Nemotron-Content-Safety-Reasoning-4B · multilingual support?_. Abgerufen von https://huggingface.co/nvidia/Nemotron-Content-Safety-Reasoning-4B/discussions/5

- YouTube. (2025, 28. Oktober). _Build Culturally-Aware LLM Guardrails With Nemotron Safety Guard_. Abgerufen von https://www.youtube.com/watch?v=uuhEAZjnePk

.svg)

.png)