Infrastrukturentscheidungen und ihre Auswirkungen auf die Softwareleistung

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- Infrastrukturentscheidungen, die die Leistung von Softwareprodukten maßgeblich beeinflussen, werden oft ohne Beteiligung der Entwickler getroffen.

- Die Architektur von Wide Area Networks (WANs) und Rechenzentren spielt eine kritische Rolle für die Zuverlässigkeit und Latenz von Anwendungen, insbesondere in verteilten Systemen und Cloud-Umgebungen.

- Traditionelle WAN-Architekturen, die auf zentralisierte Rechenzentren ausgerichtet sind, verursachen in modernen, dezentralen Systemen oft unnötige Latenz (Backhauling).

- Software-Defined Wide Area Networks (SD-WAN) bieten eine adaptive und programmierbare Lösung, um den Datenverkehr dynamisch zu routen und so die Anwendungsleistung zu optimieren.

- Eine verbesserte Kommunikation und Kollaboration zwischen Entwicklungs- und Netzwerk-Teams sowie der Einsatz von "Infrastructure as Code" sind entscheidend, um Infrastruktur und Anwendungsanforderungen aufeinander abzustimmen.

- Die wachsende Opposition gegen den Bau von KI-Rechenzentren aufgrund von Energie-, Wasser- und Lärmproblemen sowie mangelnder Transparenz bei der Planung stellt eine strategische Herausforderung dar, die über technische Aspekte hinausgeht.

- Unternehmen, die eine hohe KI-Produktivität anstreben, müssen nicht nur in KI-Tools investieren, sondern auch ihre zugrunde liegende Infrastruktur und Continuous Delivery (CD)-Praktiken verbessern, um Engpässe zu beseitigen.

- Strategische Infrastrukturentscheidungen können erhebliche Hebelwirkungen erzeugen, indem sie Abhängigkeiten, Lock-ins und Wechselkosten schaffen, die Unternehmen einen Wettbewerbsvorteil verschaffen.

Infrastrukturentscheidungen im Schatten der Entwicklung

In der heutigen schnelllebigen Technologielandschaft sind die Entscheidungen über Infrastruktur von entscheidender Bedeutung für den Erfolg von Softwareprodukten und -dienstleistungen. Oftmals werden diese weitreichenden Weichenstellungen jedoch von Entwicklern, die direkt mit den Auswirkungen konfrontiert sind, nur selten mitbestimmt. Dies führt zu einer Diskrepanz zwischen den Anforderungen der Anwendungsebene und der Realität der zugrunde liegenden Infrastruktur.

Die unsichtbare Hand der Netzwerkinfrastruktur

Wenn eine Anwendung Performance-Probleme aufweist, untersuchen Entwickler in der Regel zuerst den Code, die Datenbankabfragen oder Caching-Schichten. Häufig scheinen diese Bereiche optimiert zu sein: Die CPU-Auslastung ist stabil, der Speicherverbrauch gering und Datenbankabfragen effizient. Dennoch bleibt die Latenz bestehen. In verteilten Systemen, insbesondere in Cloud-Umgebungen, liegt die Ursache für Leistungseinbußen zunehmend in der Netzwerkschicht, nicht im Code selbst. Dies betrifft insbesondere die Architektur von Wide Area Networks (WANs), die Entwickler selten direkt beeinflussen, deren Auswirkungen sie aber stets hinnehmen müssen.

Traditionelle WAN-Designs wurden für zentralisierte Rechenzentren konzipiert. Auch nachdem Workloads in öffentliche Cloud-Plattformen verlagert wurden, blieben die Routing-Muster oft unverändert. Ein Beispiel hierfür ist das sogenannte "Backhauling": Datenverkehr von einer Filiale zu einer Cloud-Datenbank wird nicht direkt zum nächstgelegenen Cloud-Standort geleitet, sondern möglicherweise zuerst durch ein zentrales Rechenzentrum des Unternehmens zurückgeführt, bevor er zur Cloud gelangt. Dieses Muster führt zu unnötiger Latenz und Jitter, was die Leistung latenzsensibler Anwendungen erheblich beeinträchtigt. Entwickler sehen dann Timeout-Fehler, ohne die ineffizienten Paketwege zu erkennen. In hybriden Umfeldern, die MPLS-Verbindungen, VPN-Overlays, Breitband-Links und Multi-Region-Cloud-Implementierungen kombinieren, verstärken sich diese Ineffizienzen rasch.

SD-WAN als Antwort auf dynamische Anforderungen

Moderne Architekturen sind nicht mehr zentralisiert. Anwendungen basieren auf SaaS-Plattformen, verteilten APIs, regional replizierten Datenbanken und containerisierten Diensten. Das Routing des gesamten Datenverkehrs über einen zentralen Hub passt nicht mehr zu den aktuellen Verkehrsmustern, erhöht die Latenz und reduziert die Flexibilität. Mit dem Wachstum des Ost-West-Verkehrs und der zunehmenden Cloud-Adoption muss das WAN-Design adaptiv statt statisch werden. Hier kommen Software-Defined Wide Area Networks (SD-WAN) ins Spiel.

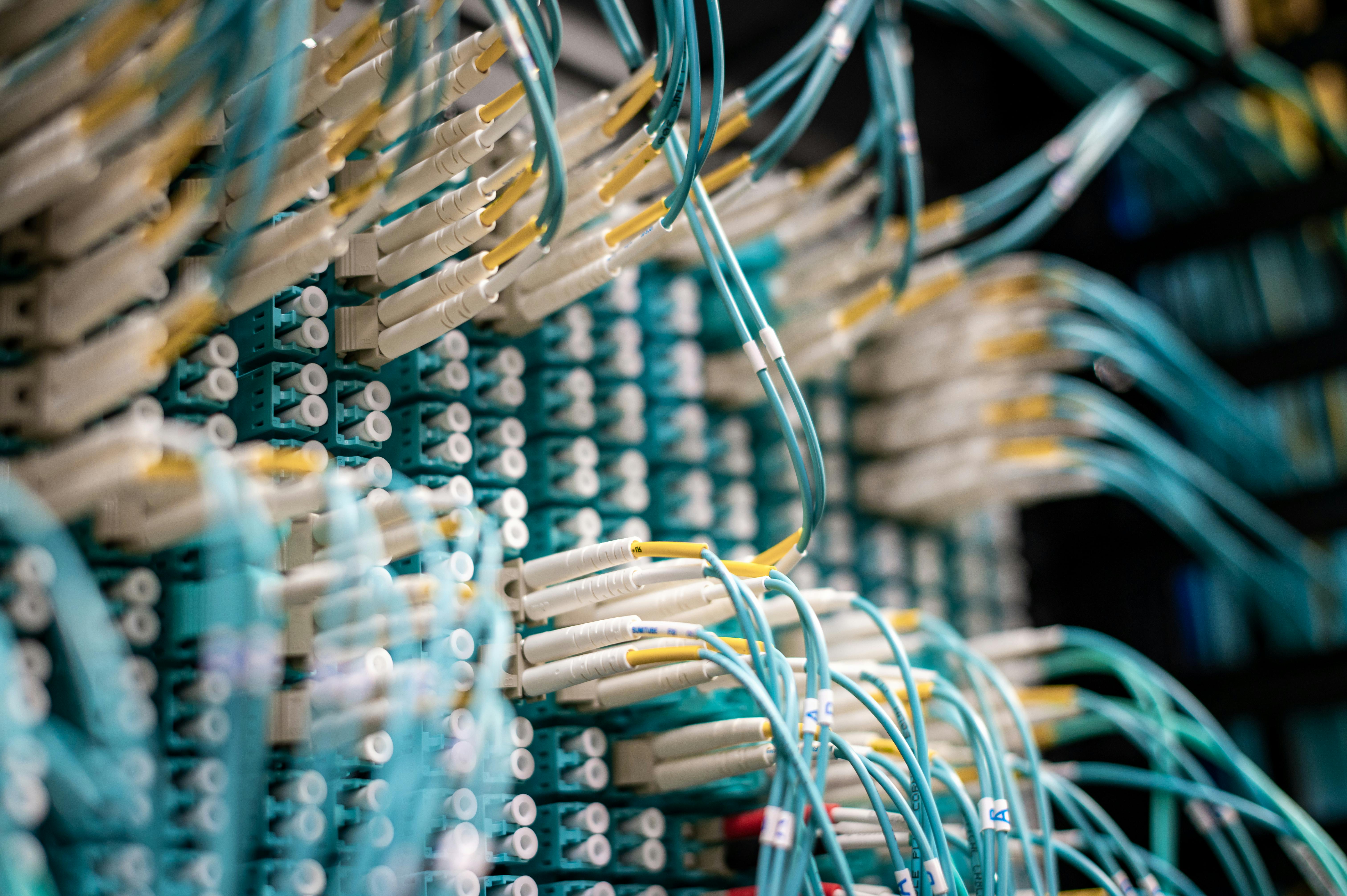

SD-WAN abstrahiert die Routing-Intelligenz von den physischen Transportverbindungen und zentralisiert die Richtlinienkontrolle. Anstatt auf feste MPLS-Pfade angewiesen zu sein, baut SD-WAN Overlay-Netzwerke über verschiedene Transportmedien auf, darunter Glasfaser, Breitband, LTE und MPLS. Controller überwachen kontinuierlich die Verbindungsqualität (Latenz, Paketverlust), und der Datenverkehr wird dynamisch entsprechend vordefinierter Richtlinien geroutet. Latenzsensible Dienste können über die stabilste Verbindung priorisiert werden, während Massendatenübertragungen auf kostengünstigere Leitungen umgeleitet werden können. Dies transformiert das WAN-Management von einer statischen Konfiguration zu einer programmierbaren Richtliniendurchsetzung.

Die Rolle der Entwickler in der Infrastruktur

Aus Entwicklersicht mag WAN-Routing außerhalb der täglichen Aufgaben liegen. In der Praxis beeinflusst es jedoch direkt die Zuverlässigkeit von Anwendungen. Microservices-Architekturen sind auf eine vorhersehbare Inter-Service-Kommunikation angewiesen. Annahmen über stabile Latenz, die in Circuit Breakern und Autoscaling-Logiken verankert sind, scheitern, wenn die WAN-Bedingungen schwanken. Eine transparente Kommunikation zwischen Entwicklungs- und Netzwerk-Teams ist daher unerlässlich. Service-Level-Ziele sollten Routing-Richtlinien beeinflussen, und Netzwerktechniker benötigen Einblick, welche Dienste strenge Latenzanforderungen haben. Ohne diese Abstimmung können Infrastrukturrichtlinien die Anwendungsleistung unbeabsichtigt beeinträchtigen.

Moderne Entwicklungspraktiken betonen Automatisierung und Reproduzierbarkeit. Infrastruktur sollte deklarativ, versionskontrolliert und konsistent bereitgestellt werden – ein Ansatz, der als "Infrastructure as Code" bekannt ist. SD-WAN-Richtlinien-Frameworks bieten hierzu APIs, die die Automatisierung von Routing-Regeln, Segmentierungsrichtlinien und Quality-of-Service-Konfigurationen ermöglichen. Dies reduziert Reibungsverluste zwischen Entwicklung und Netzwerkbetrieb und macht das Netzwerkverhalten in Staging- und Produktionsumgebungen vorhersehbarer.

Auch die Observability über verschiedene Schichten hinweg ist von Bedeutung. Moderne Observability-Stacks ermöglichen die Korrelation von Service-Antwortzeiten mit zugrunde liegenden Netzwerkmetriken. Telemetriedaten von SD-WAN-Controllern können in zentralisierte Monitoring-Plattformen integriert werden, was Entwicklern und Netzwerk-Teams eine gemeinsame Sicht auf die Leistung gibt und die Ursachenanalyse von Problemen erleichtert.

Sicherheit und Segmentierung

SD-WAN-Plattformen integrieren oft Segmentierungs- und Inspektionsfunktionen in umfassendere Sicherheitsarchitekturen. Diese Richtlinien beeinflussen, wie Dienste in verschiedenen Standorten und Cloud-Regionen kommunizieren. Für Entwickler bedeutet dies, dass Dienstabhängigkeiten, die in Staging-Umgebungen funktionieren, in der Produktion aufgrund strengerer Segmentierungsrichtlinien fehlschlagen können. Die explizite Dokumentation von Dienstkommunikationspfaden wird daher entscheidend.

In verteilten Architekturen ist die Performance eine gemeinsame Verantwortung von Entwicklung und Betrieb. Code-Effizienz, Infrastruktur-Bereitstellung und WAN-Routing-Richtlinien tragen alle dazu bei. Entwickler, die die WAN-Dynamik verstehen, können Probleme effektiver diagnostizieren, während Netzwerktechniker, die das Anwendungsverhalten verstehen, Routing-Richtlinien erstellen können, die den tatsächlichen Workload-Anforderungen entsprechen. Das WAN entwickelt sich zu einer programmierbaren Schicht des Stacks, deren Design nicht mehr ignoriert werden kann.

Die "Data Center Rebellion": Lokale Politik und KI-Infrastruktur

Jenseits der rein technischen Aspekte der Infrastruktur gibt es auch eine wachsende soziale und politische Dimension, die Infrastrukturentscheidungen beeinflusst. Insbesondere der massive Ausbau von KI-Rechenzentren stößt zunehmend auf lokalen Widerstand, der als "Data Center Rebellion" bezeichnet wird. Unternehmen investieren jährlich Hunderte von Milliarden Dollar in Rechenzentren und spezialisierte Chips, während die KI-bezogenen Einnahmen deutlich geringer sind. Dies führt zu einem Kapital-Einnahmen-Verhältnis, das in der Infrastrukturbranche herausragt.

Herausforderungen durch Energie-, Wasser- und Lärmverbrauch

KI-Rechenzentren stellen eine enorme Belastung für die lokale Infrastruktur dar. Einzelne Projekte benötigen oft 100 Megawatt oder mehr, einige Vorschläge reichen sogar in den Gigawatt-Bereich. Ein vorgeschlagenes Rechenzentrum in Michigan würde beispielsweise 1,4 Gigawatt verbrauchen, was fast dem Strombedarf von einer Million Haushalten entspricht. Dies liegt daran, dass KI-Hardware extrem dicht ist, eine massive Menge Strom verbraucht und ständig läuft, ohne "Ruhezeiten" zur Netzstabilisierung.

Die Kosten dafür tragen oft die Anwohner. In vielen Gebieten sind die Strompreise für Haushalte um 25% bis 30% gestiegen, nachdem große Rechenzentren in die Nähe gezogen sind, obwohl ihnen versprochen wurde, dass sich die Preise nicht ändern würden. Wenn Versorgungsunternehmen massive Umspannwerke für ein einziges Unternehmen bauen, werden die Kosten letztendlich auf alle verteilt. Steuervergünstigungen und Kredite für die Rechenzentren verschärfen das Problem, da die Gemeinden die Nachteile tragen, während die finanziellen Vorteile aufgezehrt werden.

Ein weiteres Problem ist der Wasserverbrauch. Hochdichte KI-Rechenleistung erzeugt enorme Hitze, die Kühlsysteme erfordert, die Millionen Gallonen Wasser pro Tag verbrauchen können. In Wüstengebieten führt dies zu direkter Konkurrenz mit der landwirtschaftlichen Bewässerung und der Trinkwasserversorgung der Haushalte. Selbst technische Lösungen wie Trockenkühlung oder geschlossene Kreislaufsysteme haben Nachteile: Trockenkühlung verlagert die Last auf den Stromverbrauch, und geschlossene Systeme verlieren immer noch Wasser durch Verdunstung.

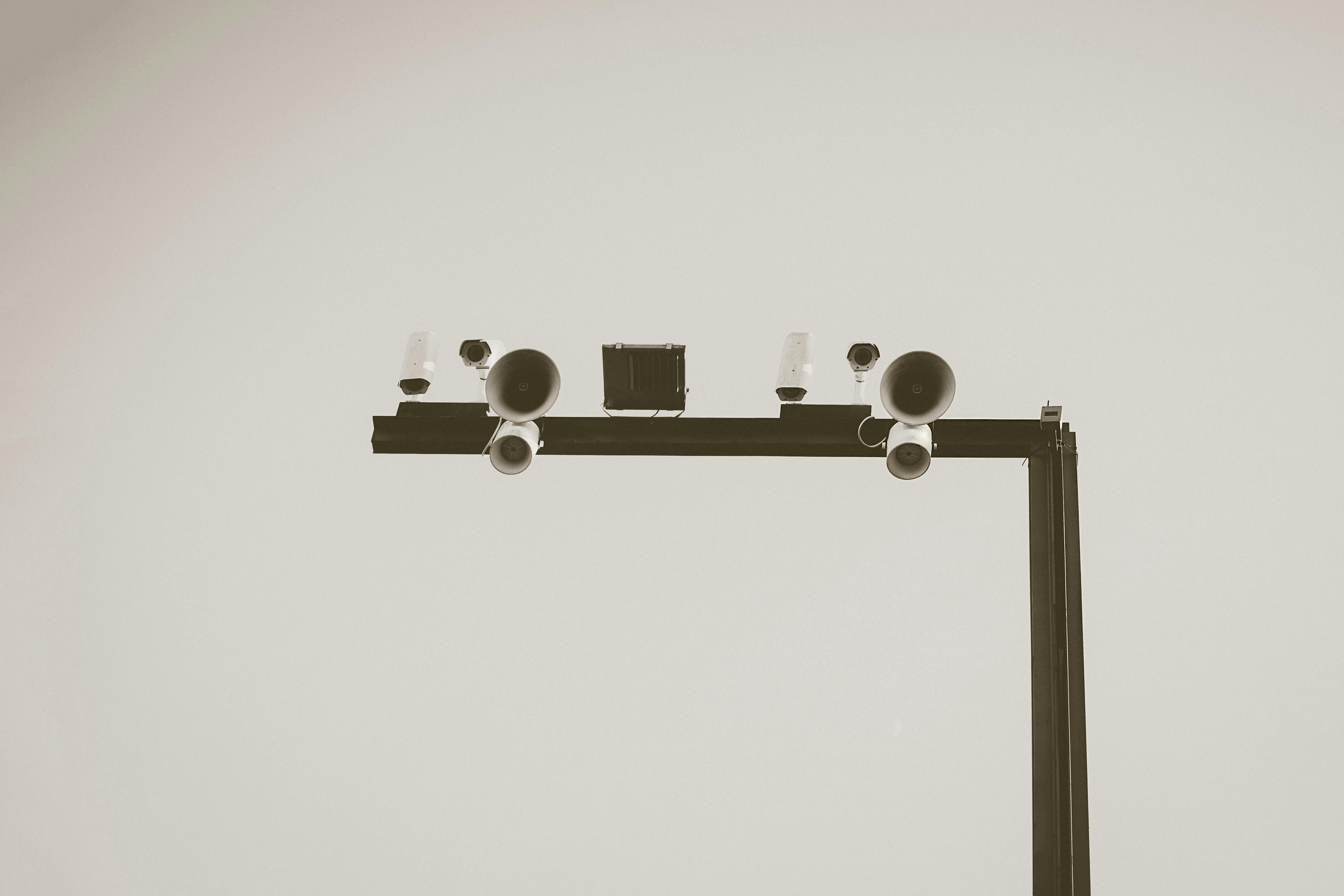

Zusätzlich erzeugen diese Anlagen erhebliche Lärmprobleme. Industrielle Kühlgebläse und Dieselgeneratoren erzeugen einen "konstanten Brummton", der eine tägliche Belästigung in zuvor ruhigen Wohngegenden darstellt. Dies führt zu Schlafstörungen und gesundheitlichen Risiken für Anwohner und kann sogar Nutztiere beeinträchtigen. Kommunen reagieren darauf mit strengeren Anforderungen wie akustischen Modellierungen, durchsetzbaren Dezibelgrenzwerten und größeren Abständen.

Der Mythos der Arbeitsplätze und mangelnde Transparenz

Gemeinden hinterfragen zunehmend, ob die geringe Anzahl der geschaffenen Arbeitsplätze die lokalen Auswirkungen wert ist. Obwohl Entwickler Milliardeninvestitionen und kurzfristige Bauarbeitsplätze hervorheben, beschäftigen KI-Rechenzentren im Dauerbetrieb deutlich weniger Personal pro Quadratmeter als vergleichbare Produktionsanlagen. Dies macht das Argument der "Arbeitsplatzschaffung" in den Augen der Anwohner hohl.

Zudem trägt die Geheimhaltung bei der Aushandlung von Verträgen oft zur Wut der Bevölkerung bei. Oft erfahren Anwohner erst spät, dass Beamte und Entwickler monatelang unter Geheimhaltungsvereinbarungen verhandelt haben, manchmal über Tarnfirmen und Codenamen. Dies untergräbt das Vertrauen und führt dazu, dass technische Behauptungen als reine Verkaufsargumente wahrgenommen werden. Eine neutrale Analyse und durchsetzbare Zusagen sind notwendig, um das Vertrauen wiederherzustellen.

Vom lokalen Widerstand zur nationalen Einschränkung

Was als isolierte Nachbarschaftsreibung begann, hat sich zu einer koordinierten nationalen Bewegung entwickelt. Oppositionsgruppen teilen rechtliche Strategien und technische Vorlagen über Bundesstaatsgrenzen hinweg. Zwischen April und Juni 2025 wurden Projekte im Wert von etwa 98 Milliarden US-Dollar blockiert oder verzögert. Dies ist nicht mehr nur ein Problem der Bauleitplanung, sondern ein politisches Minenfeld. In einigen Bundesstaaten wurden bereits Amtsträger aufgrund der Genehmigung von Rechenzentren abgewählt.

Obwohl die USA bei High-End-Chips führend sind, stoßen sie bei der Verwaltung grundlegender Ressourcen wie Strom und Wasser an Grenzen. Während China eine zentralisierte Kontrolle über Energie und Infrastruktur besitzt, erfordert das demokratische Modell der USA Transparenz und öffentliche Akzeptanz. Wenn US-Unternehmen weiterhin auf geheime Deals setzen, um teure, überdimensionierte Infrastruktur durchzusetzen, riskieren sie einen vollständigen Zusammenbruch des Vertrauens in der Gemeinschaft.

Der Infrastruktur-Gap und seine Auswirkungen auf die KI-Produktivität

Trotz erheblicher Investitionen in KI-Tools zur Steigerung der internen Produktivität kämpfen viele Unternehmen mit der tatsächlichen Skalierung von KI-Anwendungen. Studien zeigen, dass nur ein kleiner Prozentsatz der Unternehmen sich als "reif" in Bezug auf die KI-Bereitstellung betrachtet. Die Einführung von KI-Tools kann sogar zu einem Rückgang des Durchsatzes und der Stabilität führen, da Code schneller geschrieben wird, aber nicht schneller in die Produktion gelangt.

Engpässe in der Bereitstellung und der Entwickleralltag

Entwickler nutzen KI, um Code schneller zu produzieren, aber dieser muss immer noch den gesamten Bereitstellungsprozess durchlaufen, einschließlich Code-Reviews, Tests, Sicherheitsprüfungen und Deployment. Die durch KI-Tools gewonnene Zeit geht in den nachgeschalteten Engpässen verloren. Dies wird durch KI-generierten Code noch verschärft, da dieser oft größere Änderungssätze erzeugt, die Code-Reviews aufblähen und deren Verständnis erschweren.

Entwickler verbringen nur einen Bruchteil ihrer Zeit mit dem Schreiben von Code. Der Großteil entfällt auf technische Entscheidungsfindung, Mentoring, Projektkoordination und Bereitstellungsprozesse. Während KI-Tools beim Generieren von Code und bei Routineaufgaben helfen, wünschen sich Entwickler Automation für nicht-kodierende Aufgaben wie Onboarding, Compliance, Sicherheit, Incident- und Deployment-Management. Dies deutet auf eine Lücke zwischen dem vermeintlichen Wert von KI und den tatsächlichen Problemen der Entwickler hin.

Continuous Delivery als Schlüssel zur Wertschöpfung

Um den vollen Wert von KI zu erschließen, sind Continuous Delivery (CD)-Praktiken unerlässlich. CD ermöglicht es, Änderungen sicher, schnell und nachhaltig in die Produktion zu überführen. Dies beinhaltet Continuous Integration (CI), automatisierte Tests und Deployment-Automatisierung. Automatisierung kann das erhöhte Code-Volumen, das durch KI generiert wird, bewältigen und so einen konsistenten Durchsatz durch die Lieferpipeline gewährleisten. Schnellere Feedback-Zyklen durch CI helfen, Probleme frühzeitig zu erkennen und zu beheben, wenn sie noch kostengünstig sind.

Unternehmen, die erfolgreich KI implementieren, verfügen in der Regel über solide Grundlagen in ihren Delivery-Praktiken. Ohne diese Grundlagen fällt es schwer, den vollen Nutzen aus KI-Investitionen zu ziehen. DORA-Metriken (Deployment-Häufigkeit, Lead Time, Wiederherstellungszeit und Fehlerrate) sind hier praktische Messgrößen. Hochleistungsfähige Teams zeichnen sich durch spezifische CD-Merkmale aus, die manuelle Engpässe beseitigen und schnelle Feedback-Zyklen schaffen. Beispielsweise berichtete Amazon über eine deutliche Steigerung der wöchentlichen Produktions-Deployments und eine Reduzierung der Software-Delivery-Kosten durch Verbesserungen der Entwicklererfahrung und Investitionen in die Automatisierungsinfrastruktur, ohne sich ausschließlich auf KI-Tools zu verlassen.

Die Reihenfolge der Investitionen ist entscheidend: Organisationen, die ihre zugrunde liegende Bereitstellungspipeline stärken, bevor sie KI-Investitionen skalieren, sind besser positioniert, um Produktivitätsgewinne in greifbare Verbesserungen der Softwarebereitstellung umzusetzen. Ohne eine klare Absicht und ein solides Fundament kann die KI-Einführung bestehende Probleme verstärken, anstatt sie zu lösen.

Strategische Hebelwirkungen durch Infrastrukturentscheidungen

Infrastrukturentscheidungen sind nicht neutral; sie schaffen strategische Hebelwirkungen, die den Erfolg eines Unternehmens maßgeblich beeinflussen können. Es geht nicht darum, die technisch beste Lösung zu finden, sondern diejenige, die Abhängigkeiten, Lock-ins und Wechselkosten erzeugt, die einen Wettbewerbsvorteil sichern.

Strategische Entscheidungen: Own, Rent oder Partner?

Jede Infrastrukturentscheidung läuft auf eine von drei strategischen Optionen hinaus:

- Own (Besitzen und Kontrollieren): Hohe Vorlaufkosten, hohe Kontrolle, potenzieller struktureller Vorteil bei Skalierung. Für Hyperscaler wie Google, Meta, Microsoft und Amazon ist das Besitzen fast der gesamten Infrastruktur eine strategische Waffe, da es Kostenvorteile und architektonische Kontrolle bietet.

- Rent (Mieten): Geringe Vorlaufkosten, geringe Kontrolle, flexibel, aber bei Skalierung potenziell teuer. Für AI-native Startups ist das Mieten zunächst die rationale Wahl, um schnell Produkt-Markt-Fit zu finden.

- Partner (Strategische Partnerschaft): Mittlere Kosten, mittlere Kontrolle, hohe gegenseitige Abhängigkeit. Frontier AI Labs wie OpenAI gehen hybride Wege, indem sie kritische Komponenten selbst besitzen und für andere eine tiefe Partnerschaft eingehen.

Die richtige Frage ist nicht "Welche Option ist die günstigste?", sondern "Welche Option schafft die größte strategische Hebelwirkung für unsere Position, unsere Skalierung und unser Wettbewerbsumfeld?"

Die "Seven Powers" im Kontext der Infrastruktur

Hamilton Helmers "Seven Powers"-Framework lässt sich auf die KI-Infrastruktur anwenden, um zu verstehen, wo Wettbewerbsvorteile entstehen:

- Skaleneffekte: Hyperscaler profitieren von massiven Skaleneffekten bei physischer Infrastruktur und der Entwicklung von Custom-Chips, was zu strukturellen Kostenvorteilen führt.

- Netzwerkeffekte: Plattformen wie Hugging Face oder GitHub werden wertvoller, je mehr Nutzer sie haben, was zu einem Winner-takes-most-Dynamik führt.

- Counter-Positioning: Open-Source-Modelle von Unternehmen wie Meta (PyTorch, LLaMA) untergraben die Geschäftsmodelle proprietärer Cloud-Plattformen, da die etablierten Anbieter diese Ansätze nicht kopieren können, ohne ihr eigenes Geschäft zu kannibalisieren.

- Wechselkosten: Cloud-Anbieter, Databricks oder MLOps-Plattformen schaffen hohe Wechselkosten durch tiefe Integrationen, proprietäre Formate und APIs, die Kunden an die Plattform binden.

- Branding: In Unternehmensmärkten reduzieren Marken wie AWS oder Microsoft Azure das wahrgenommene Risiko und schaffen einen "Default-Vendor"-Status.

- Cornered Resource (Eingegrenzte Ressource): Die Kontrolle über knappe, nicht replizierbare Ressourcen wie GPU-Lieferketten (NVIDIA), Kapital für Infrastruktur-Buildouts (Hyperscaler) oder exklusive Partnerschaften verschafft Preismacht.

- Process Power (Prozessleistung): Akkumuliertes organisatorisches Wissen über den zuverlässigen und effizienten Betrieb komplexer Infrastruktur, wie Metas Trainingseffizienz oder Googles Cluster-Orchestrierung.

Machtkämpfe in der Infrastrukturlandschaft

Die Infrastrukturlandschaft ist ein mehrdimensionaler Machtkampf:

- Hyperscaler vs. Spezialisierte Infrastruktur-Anbieter: Hyperscaler streben nach vertikaler Integration und bündeln spezialisierte Funktionen in ihren Cloud-Plattformen, während Spezialisten auf Best-of-Breed-Differenzierung und Cloud-Agnostik setzen.

- NVIDIA vs. Hyperscaler (und alle anderen): NVIDIA dominiert den GPU-Markt durch seine Hardware und das CUDA-Ökosystem, während Hyperscaler eigene Custom-Chips entwickeln, um die Abhängigkeit zu reduzieren und Kosten zu senken.

- Open vs. Closed Infrastructure: Open-Source-Ansätze (Meta, Hugging Face) zielen darauf ab, die Infrastrukturschicht zu kommodifizieren und Wert in der Anwendungsebene zu konzentrieren, während proprietäre Anbieter (OpenAI, AWS) durch Kontrolle über Infrastruktur und Modelle Wert abschöpfen.

- Incumbents vs. AI-Native Startups: Traditionelle Infrastrukturunternehmen versuchen, KI-Funktionen in ihre bestehenden Produkte zu integrieren, während AI-native Startups zweckgebundene Infrastruktur für spezifische KI-Workloads entwickeln.

Erfolgreiche Strategien in der Infrastruktur

Unternehmen, die Infrastruktur als strategische Waffe betrachten, verfolgen oft folgende erfolgreiche Strategien:

- Vertikale Integration an Engpassstellen: Kontrolle über den Flaschenhals in der Wertschöpfungskette, wie NVIDIAs Übernahme von Mellanox für Infiniband-Netzwerke.

- Aufbau von Expertise, wo operatives Wissen sich kumuliert: Investitionen in Bereiche, wo akkumulierte operative Erfahrung dauerhafte Vorteile schafft, z.B. Metas Trainingseffizienz.

- Schaffung von zweiseitigem Lock-in: Infrastruktur, die sowohl Lieferanten als auch Kunden bindet, wie Databricks mit seiner Plattform für Daten- und ML-Teams.

- Subventionierung der Infrastruktur zur Erfassung von Anwendungswert: Bereitstellung von Infrastruktur (oft mit Verlust), um Wert in der Anwendungsebene zu erfassen, wo die Margen höher sind, z.B. Metas Open-Sourcing von PyTorch und LLaMA.

- Kontrolle des Standards, nicht nur der Implementierung: Open-Source-Implementierungen, aber Kontrolle über den Standard, um das Ökosystem zu prägen, wie Databricks mit Delta Lake oder Google mit Kubernetes.

- Vertikale statt horizontale Spezialisierung: Aufbau von Infrastruktur für eine spezifische Branche oder einen Anwendungsfall, nicht für allgemeine Zwecke, z.B. Scale AI für autonome Fahrzeuge.

Die Schwerkraft des Standardpfades: Wenn die Schnittstelle die Entscheidungen trifft

Manchmal sind es unscheinbare Entscheidungen – wie ein Verhältnis von 90/10 bei der Finanzierung – die über Jahrzehnte hinweg die Entwicklung von Infrastruktur und Gesellschaft prägen. Dieses Phänomen, bei dem eine "Schnittstelle" (Interface) unzählige individuelle Entscheidungen in eine bestimmte Richtung lenkt, ohne dass eine explizite Wahl getroffen wird, hat weitreichende Auswirkungen.

Die Macht der Schnittstelle

Eine Schnittstelle ist hier definiert als die Schicht von Regeln, die bestimmte Entscheidungen als natürlich und andere als kostspielig erscheinen lässt – Standardeinstellungen, Förderkriterien, Finanzierungsquoten, Abwicklungswege, Informationssichtbarkeit und Verantwortlichkeit. Sie ist keine einzelne Anreizquelle, sondern eine Reihe struktureller Beschränkungen, die das Verhalten in Richtung einer Standardlösung lenken. Wenn der Kanal einmal ausgeformt ist, ist die Richtung des Flusses nicht mehr zufällig.

Die Kraft der Schnittstelle liegt nicht im Befehlen, sondern darin, die "Akzeptanz" immer mehr als Standard erscheinen zu lassen und die "Ablehnung" immer mehr als eine erklärungsbedürftige Ausnahme. Sie muss niemanden befehlen; indem sie Kosten und Wege neu definiert, kann sie das Verhalten unzähliger Menschen so konvergieren lassen, als ob sie es "fast von selbst" täten. Das, was wir als "Wahl" bezeichnen, kann in Wirklichkeit eine Reaktion auf eine unsichtbare Schnittstelle sein, die die Kosten der Ablehnung stillschweigend erhöht hat.

Der Agency Error: Wenn Drängen als freiwillige Wahl missverstanden wird

Oftmals erklären wir historische Entwicklungen im Nachhinein als Konsens oder rationale Entscheidungen. Doch die wahre Funktionsweise eines Systems gleicht eher dem hydraulischen Ingenieurwesen: Wir werden nicht immer überzeugt, sondern passen uns einem vorgeformten Terrain an. Wenn die Kosten der Ablehnung hoch genug sind, um die meisten Menschen zum Schweigen zu bringen, benötigt das System keine Argumente mehr; es legt einfach den Weg fest.

Es gibt jedoch Momente, in denen die Schnittstelle noch nicht vollständig verhärtet ist und umgeschrieben werden kann – sogenannte "Nähte" (seams). Diese "Agency Windows" sind Zeiten, in denen die gestaltende Kraft des alten Protokolls nachlässt und der neue Standard noch nicht vollständig etabliert ist. Signale für solche Nähte sind:

- Entkopplung von Nutzen und Protokoll: Wenn formelle Regeln beibehalten werden, die eigentliche Arbeit aber über "Schattenkanäle" läuft, verliert die alte Schnittstelle ihre Macht.

- Strukturelle Liquidität: Krisen oder neue Technologien können die Trägheit stabiler Systeme vorübergehend aufbrechen und den "Lock-in"-Schwellenwert senken.

- Unerwartete Ausrichtung von Anreizen: Wenn Stakeholder, die einst gegensätzliche Interessen hatten, mit einer gemeinsamen, unvermeidbaren externen Herausforderung konfrontiert werden, kann dies ein temporäres "read-write window" schaffen, in dem Kompromisse eingegangen werden.

Wenn Hebelwirkungen versagen: Zu tief verwurzelte Pfade

Manchmal scheitern selbst vernünftige und fortschrittliche Vorschläge, weil der Standardpfad bereits zu tief – wie ein Canyon – eingegraben ist. Das Wasser rauscht hindurch, und egal wie man paddelt, die Richtung des Flusses lässt sich kaum ändern. Beispiele hierfür sind das Gesundheitssystem und Studiengebühren, wo trotz hoher Kosten und sichtbarer Daten die strukturellen Lock-ins so stark sind, dass Reformen kaum greifen.

Der "Agency Error" besteht darin, zu glauben, dass wir immer die Wahl haben. In Wirklichkeit ist "Agency" kein dauerhafter Zustand, sondern ein vorübergehendes Fenster. Für Architekten bedeutet dies, nicht nur zu fragen "Kann ich Dinge ändern?", sondern auch: Sind Nähte aufgetaucht? Ist die Schnittstelle stark genug, um Ablehnung zu erschweren oder Akzeptanz zu erleichtern? Wird eine Synchronisierung stattfinden? Wird ein Lock-in eintreten? Und ist das Änderungsfenster noch offen?

Eine Schnittstelle besteht, weil wir durch sie fließen. Sie nutzt unser eigenes Gewicht, um sich zu verfestigen. Die entscheidende Frage ist nicht, wer den Kanal damals gebaut hat, sondern: Gehen wir nur den Pfad entlang, oder sind wir es, die den Canyon vertiefen?

Fazit

Die Entscheidungen, die die Infrastruktur eines Unternehmens prägen, sind von fundamentaler Bedeutung und wirken sich direkt auf die Leistungsfähigkeit, Zuverlässigkeit und Skalierbarkeit von Software und KI-Anwendungen aus. Die hier dargelegte Analyse zeigt, dass diese Entscheidungen weit über rein technische Aspekte hinausgehen und sowohl organisatorische, strategische als auch sozio-politische Dimensionen umfassen. Für ein B2B-Publikum, das sich mit der Implementierung und Skalierung von KI-Technologien befasst, ergeben sich daraus klare Handlungsempfehlungen:

- Proaktive Einbindung von Entwicklern: Die Erfahrungen zeigen, dass eine frühzeitige und kontinuierliche Einbindung von Entwicklern in Infrastrukturentscheidungen unerlässlich ist. Ihr tiefes Verständnis der Anwendungsanforderungen kann dazu beitragen, Latenzprobleme zu identifizieren und die Infrastruktur optimal auf die Workloads abzustimmen.

- Adaptives WAN-Design und SD-WAN: Unternehmen sollten starre, zentralisierte WAN-Architekturen überdenken und adaptive SD-WAN-Lösungen in Betracht ziehen. Diese ermöglichen eine dynamische Verkehrssteuerung und eine bessere Performance für verteilte und Cloud-native Anwendungen.

- Kollaboration und "Infrastructure as Code": Eine enge Zusammenarbeit zwischen Entwicklungs- und Netzwerk-Teams ist entscheidend. Der Einsatz von "Infrastructure as Code" fördert Automatisierung, Reproduzierbarkeit und eine deklarative Verwaltung der Infrastruktur, was Reibungsverluste reduziert und die Bereitstellung beschleunigt.

- Ganzheitliche Observability: Moderne Observability-Stacks, die Anwendungs- und Netzwerkmetriken korrelieren, sind notwendig, um die Ursachen von Performance-Problemen schnell und präzise zu identifizieren.

- Berücksichtigung externer Faktoren bei der Rechenzentrumsplanung: Bei der Planung von KI-Rechenzentren müssen Unternehmen die lokalen politischen, ökologischen und sozialen Auswirkungen berücksichtigen. Transparenz, Dialog mit den Gemeinden und nachhaltige Lösungen sind entscheidend, um Widerstand zu vermeiden und langfristige Akzeptanz zu sichern.

- Priorisierung von Continuous Delivery (CD): Um den vollen Nutzen aus KI-Investitionen zu ziehen, müssen Unternehmen ihre CD-Praktiken stärken. Automatisierung von Tests und Deployment, schnelle Feedback-Zyklen und die Beseitigung von Engpässen in der Pipeline sind Voraussetzungen für eine effiziente KI-Bereitstellung.

- Strategische Infrastrukturentscheidungen nutzen: Infrastruktur sollte als strategisches Instrument betrachtet werden, um Wettbewerbsvorteile zu schaffen. Die bewusste Entscheidung zwischen "Own, Rent oder Partner" sowie die Nutzung von Skaleneffekten, Netzwerkeffekten und Wechselkosten können langfristig die Marktposition stärken.

- Bewusstsein für "Standardpfade": Unternehmen sollten sich der "Schwerkraft des Standardpfades" bewusst sein und hinterfragen, ob Entscheidungen wirklich frei getroffen werden oder durch zugrunde liegende Schnittstellen vorprogrammiert sind. Das Erkennen von "Nähten" – Momenten, in denen die Schnittstelle noch formbar ist – bietet Gelegenheiten für echte Innovation und Kurskorrektur.

Die Infrastruktur ist keine passive Grundlage, sondern eine aktive Ebene, die Macht konzentriert, Wettbewerbsvorteile schafft oder abbaut. Unternehmen, die dies erkennen und ihre Infrastrukturentscheidungen strategisch und ganzheitlich angehen, werden in der Lage sein, die Potenziale von KI voll auszuschöpfen und nachhaltigen Erfolg zu sichern.

Bibliographie

- Mulyandari, Rene. "The infrastructure decisions that developers rarely get a say in". Developer Tech News. 23. Februar 2026.

- Lorica, Ben. "Beyond the Chips: The Local Politics of AI Infrastructure". Gradient Flow. 4. Februar 2026.

- Dua, Mandhir. "How Infrastructure decisions create leverage". Substack: Decision Memo. 21. Februar 2026.

- Fleming, Charlotte. "This simple infrastructure gap is holding back AI productivity". The New Stack. 22. Februar 2026.

- Zhen. "The Gravity of the Default Path: When the "Interface" Makes Choices for Us". DEV Community. 17. Februar 2026.

- Gallery, David. "Project Developers Ignore Lessons Learned". LinkedIn. 4. Februar 2026.

- Lorica, Ben. "The "Data Center Rebellion" is here". Substack: Gradient Flow. 3. Februar 2026.

- Hurtt, Tom. "What Software Developers Can Learn From Big Infrastructure Projects". Simple Thread. 30. November 2023.

- Lindamood, Jack. "(Almost) Every infrastructure decision I endorse or regret after 4 years running infrastructure at a startup". Medium. 6. Februar 2024.

- Housing Australia. "Developer contributions - How should we pay for new local infrastructure?". Housing Australia. 31. August 2021.

.svg)

.png)