EgoForge: Neuer Ansatz für zielgerichtete egozentrische Videosimulation

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- EgoForge ist ein wegweisender egozentrischer, zielgerichteter Weltsimulator, der kohärente Videos aus der Ich-Perspektive generiert.

- Das System erfordert nur minimale statische Eingaben: ein einzelnes egozentrisches Bild, eine übergeordnete Anweisung und optional eine exozentrische Ansicht.

- Ein zentraler Bestandteil ist VideoDiffusionNFT, eine belohnungsgesteuerte Verfeinerung auf Trajektorie-Ebene, die Zielerreichung, temporale Kausalität, Szenenkonsistenz und perzeptuelle Wiedergabetreue optimiert.

- Im Gegensatz zu früheren Modellen, die umfangreiche Daten wie Kameratrajektorien oder multikamerale Aufnahmen benötigen, arbeitet EgoForge mit deutlich weniger Informationen.

- Die Technologie zeigt vielversprechende Anwendungen in der virtuellen Realität, im Robotertraining und in der Mensch-KI-Kollaboration.

Revolution in der Ich-Perspektiven-Simulation: EgoForge definiert die Weltmodelle neu

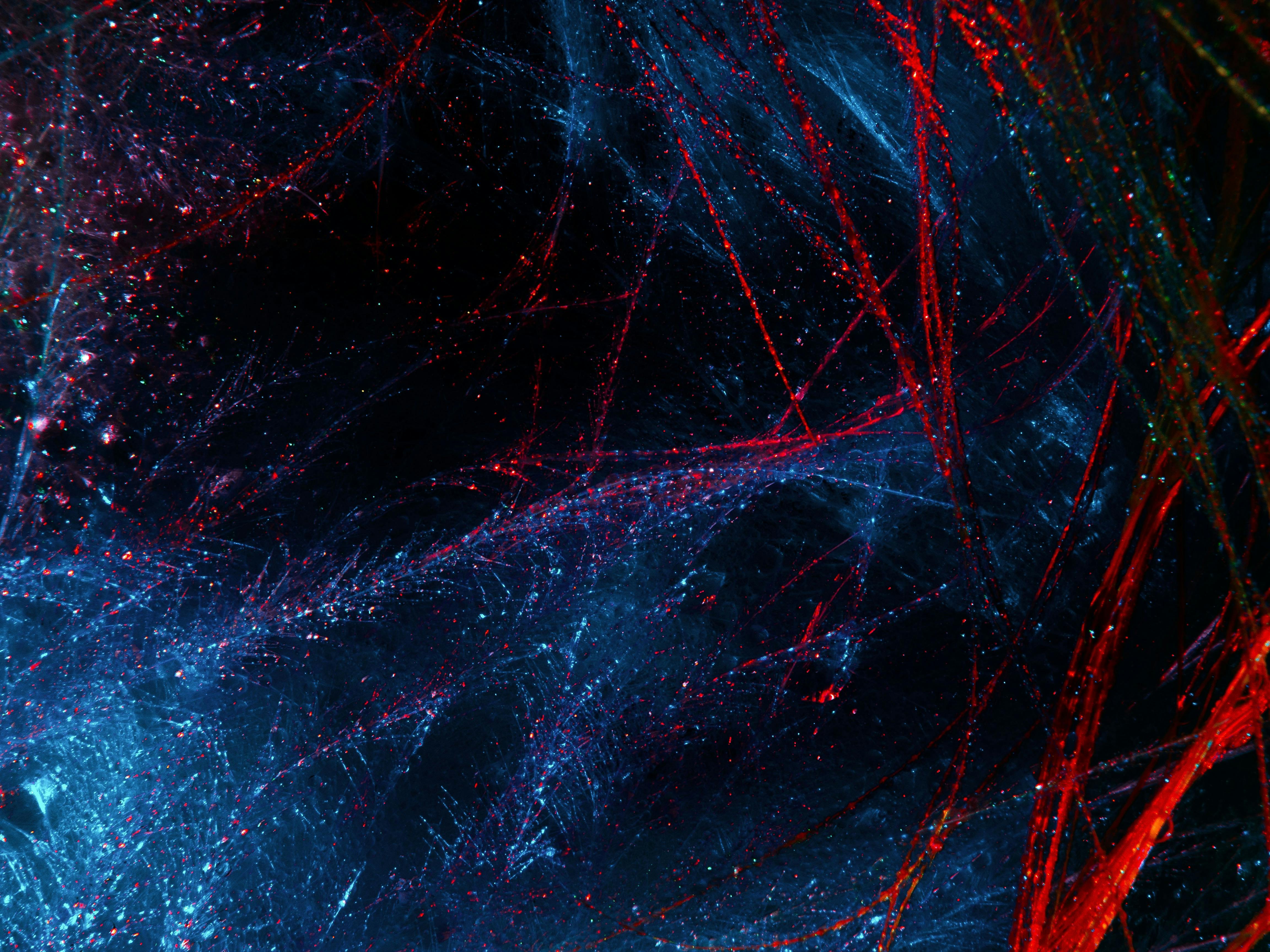

Die Fähigkeit von KI-Systemen, dynamische Umgebungen zu simulieren und zukünftige Ereignisse vorherzusagen, hat in den letzten Jahren erhebliche Fortschritte gemacht. Insbesondere die Erstellung von Videos aus der Ich-PersPerspektive, die sogenannte egozentrische Videosimulation, stellt jedoch aufgrund ihrer Komplexität eine besondere Herausforderung dar. Schnelle Blickwinkelwechsel, häufige Interaktionen zwischen Hand und Objekten sowie zielgerichtete Abläufe, deren Entwicklung von menschlicher Absicht abhängt, erschweren die Modellierung erheblich. Aktuelle Ansätze konzentrieren sich oft auf handzentrierte Anweisungssynthese mit begrenzter Szenenentwicklung, führen statische Ansichtsübersetzungen ohne Modellierung der Aktionsdynamik durch oder erfordern eine dichte Überwachung, beispielsweise durch Kameratrajektorien oder synchronisierte Multikamera-Aufnahmen.

In diesem Kontext stellt das Forschungsprojekt EgoForge: Goal-Directed Egocentric World Simulator einen bedeutenden Fortschritt dar. EgoForge ist ein innovativer egozentrischer, zielgerichteter Weltsimulator, der in der Lage ist, kohärente Videos aus der Ich-Perspektive zu generieren. Dies geschieht auf Basis minimaler statischer Eingaben: ein einzelnes egozentrisches Bild, eine übergeordnete Anweisung und optional eine zusätzliche exozentrische Ansicht.

Die technologische Grundlage: VideoDiffusionNFT

Um die Ausrichtung auf die Absicht des Nutzers und die zeitliche Konsistenz der generierten Videos zu verbessern, wurde in EgoForge eine neuartige Methode namens VideoDiffusionNFT entwickelt. Diese Methode nutzt eine belohnungsgesteuerte Verfeinerung auf Trajektorie-Ebene während der Diffusionsabtastung. Dabei werden verschiedene Aspekte optimiert, darunter die Zielerreichung, die temporale Kausalität, die Szenenkonsistenz und die perzeptuelle Wiedergabetreue. Dies ermöglicht es dem System, realistische und physikalisch plausible Handlungen zu simulieren, die den gegebenen Anweisungen folgen.

Ein Kernmerkmal von EgoForge ist die Fähigkeit, komplexe menschliche Interaktionen und Bewegungen detailgetreu abzubilden. Das System kann beispielsweise aus einem einzelnen Foto einer Küche und der Anweisung „Kaffee eingießen“ eine kohärente Videosequenz dieser Handlung aus der eigenen Perspektive des Nutzers erstellen. Diese Fähigkeit zur Vorhersage von Aktionen basierend auf minimalen visuellen Informationen und einer Zielvorgabe unterscheidet EgoForge von früheren Ansätzen, die oft umfangreiche Vorabdaten oder komplexe Überwachung erforderten.

Herausforderungen und Innovationen in der egozentrischen Simulation

Die Simulation aus der Ich-Perspektive ist inhärent schwierig. Die Kamera ist nicht frei schwebend, sondern fest mit einem menschlichen Körper verbunden, der sich bewegt, dreht, beugt, greift und mit Objekten interagiert. Jede Bewegung des Rumpfes oder Arms verändert das Sichtfeld. Diese enge Kopplung zwischen Aktion und Wahrnehmung ist genau das, was die meisten Videogenerierungsmodelle bisher nicht erfassen konnten. Bestehende Modelle, die auf Text oder Kameratrajektorien konditioniert sind, können zwar ästhetisch ansprechende Sequenzen generieren, stoßen jedoch an ihre Grenzen, wenn sie sich wie ein verkörperter Agent verhalten sollen.

EgoForge begegnet diesen Herausforderungen, indem es auf einem Diffusions-Transformer-Backbone aufbaut, das statische Bilder in dynamische bewegte Sequenzen umwandelt. Es integriert eine „geometrie-schwache Überwachung“, um das 3D-Raumverständnis der KI zu verbessern. Dies gewährleistet, dass die generierten Videos physikalischen Gesetzen folgen und eine stabile Struktur beibehalten, selbst wenn sich der Blickwinkel ändert.

Vergleich mit bestehenden Weltmodellen

Im Vergleich zu anderen Weltmodellen wie „PlayerOne“ oder „EgoControl“ zeigt EgoForge spezifische Stärken. Während „PlayerOne“ beispielsweise den ersten egozentrischen, realistischen Weltsimulator darstellt, der eine immersive und uneingeschränkte Erkundung in dynamischen Umgebungen ermöglicht und sich auf die Konstruktion einer entsprechenden Welt aus einem egozentrischen Szenenbild konzentriert, legt EgoForge einen stärkeren Fokus auf zielgerichtete Aktionen und die Verfeinerung durch belohnungsgesteuerte Trajektorien. „EgoControl“ wiederum konzentriert sich auf die steuerbare Simulation von Videos aus der Ich-Perspektive durch volle Körperhaltung, um die Wahrnehmung mit der Aktion in Einklang zu bringen. EgoForge erweitert diesen Ansatz durch die Integration eines übergeordneten Ziels und die iterative Verfeinerung der Trajektorie.

Die Forschung hinter EgoForge hat auch einen neuen Benchmark-Datensatz namens X-Ego erstellt. Dieser Datensatz umfasst 15.000 Trainingsbeispiele mit detaillierten Anmerkungen zu Hand-Objekt-Dynamiken und Objektzustandsänderungen. Experimente zeigen, dass EgoForge im Vergleich zu anderen hochmodernen Modellen signifikante Verbesserungen in Bezug auf die semantische Ausrichtung und die Bewegungsgenauigkeit erzielt. Beispielsweise reproduziert EgoForge bei einer Handwaschaufgabe komplexe mehrstufige Aktionen präziser als andere Modelle, die möglicherweise zusätzliche Hände halluzinieren oder das Waschbecken ignorieren.

Anwendungen und zukünftige Potenziale

Die potenziellen Anwendungsbereiche von EgoForge sind vielfältig. In der virtuellen Realität könnte es zur Schaffung immersiverer und reaktionsfähigerer digitaler Erlebnisse beitragen, indem es KI-Assistenten ermöglicht, die nächsten Schritte des Nutzers vorherzusehen. Im Robotertraining könnte es virtuelle Umgebungen bieten, die menschliche Interaktionen perfekt nachahmen, und so die Entwicklung von Robotern mit komplexen Manipulationsfähigkeiten beschleunigen. Darüber hinaus könnte die Technologie die Mensch-KI-Kollaboration in der physischen Welt revolutionieren, indem sie ein tieferes Verständnis menschlicher Absichten ermöglicht.

Die Fähigkeit, zielgerichtete Aktionen zu simulieren, eröffnet neue Möglichkeiten für die Interaktion zwischen Mensch und KI. Durch die Integration in tragbare Technologien wie Smart Glasses könnten KI-Systeme in Echtzeit auf die Absichten der Nutzer reagieren und assistieren, was eine neue Ära der personalisierten und proaktiven Unterstützung einläuten könnte.

Fazit

EgoForge stellt einen wichtigen Schritt in der Entwicklung von Weltmodellen dar, die egozentrische, zielgerichtete Simulationen mit hoher Kohärenz und minimalem Input ermöglichen. Durch die innovative Kombination von Diffusionsmodellen und belohnungsgesteuerter Verfeinerung adressiert es zentrale Herausforderungen der egozentrischen Videosynthese. Die erzielten Verbesserungen in der semantischen Ausrichtung, der geometrischen Stabilität und der Bewegungsgenauigkeit ebnen den Weg für transformative Anwendungen in der virtuellen Realität, im Robotertraining und in der Mensch-KI-Kollaboration, indem sie KI-Systemen ein tiefgreifenderes Verständnis menschlicher Absichten und Interaktionen ermöglichen.

.svg)

.png)